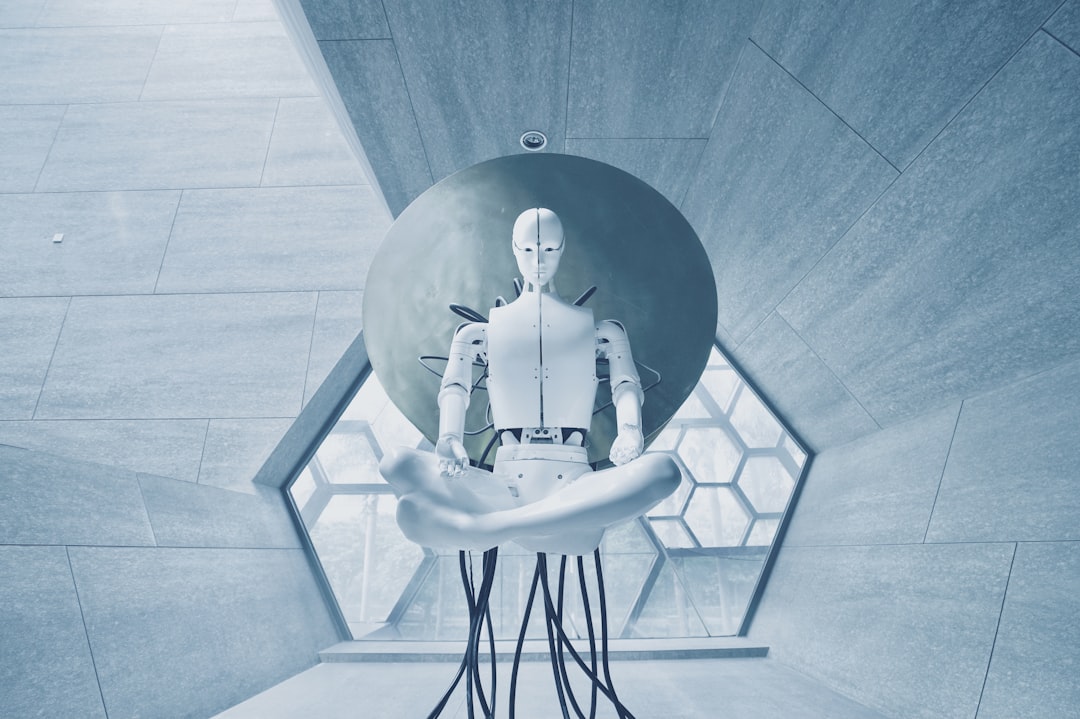

El Auge de los Robots Autónomos

Estamos presenciando una revolución silenciosa pero profunda: los robots están abandonando las jaulas de seguridad de las fábricas y las páginas de la ciencia ficción para integrarse en nuestra vida cotidiana. Vehículos autónomos recorren nuestras calles, drones sobrevuelan nuestras ciudades, robots asistenciales entran en nuestros hogares y algoritmos de toma de decisiones influyen en aspectos críticos de nuestras vidas.

Esta transición de robots programados y controlados a sistemas autónomos capaces de percibir, aprender y tomar decisiones independientes representa un salto cualitativo con profundas implicaciones para nuestra sociedad. A diferencia de herramientas pasivas que simplemente ejecutan órdenes, estos sistemas actúan cada vez más como agentes con cierto grado de autonomía, planteando cuestiones que van al corazón de nuestra comprensión de conceptos como responsabilidad, seguridad, privacidad y dignidad humana.

Dilemas Éticos Fundamentales

La integración de robots autónomos en nuestra sociedad nos enfrenta a dilemas éticos que no tienen respuestas sencillas:

El Problema de la Responsabilidad

Cuando un sistema robótico autónomo toma una decisión que causa daño, ¿quién es responsable? ¿El fabricante que lo diseñó? ¿El programador que escribió su código? ¿El usuario que lo operaba? ¿O el propio sistema, si ha aprendido y evolucionado más allá de su programación original?

Este "vacío de responsabilidad" se hace especialmente evidente en sistemas de aprendizaje automático cuyo comportamiento emerge de datos y experiencias más que de reglas programadas explícitamente. La opacidad de estos sistemas (a menudo denominada el problema de la "caja negra") complica aún más la asignación de responsabilidad, ya que incluso sus creadores pueden tener dificultades para explicar exactamente por qué el sistema tomó una determinada decisión.

Sesgos y Discriminación Algorítmica

Los sistemas robóticos y de IA aprenden de datos históricos que a menudo contienen sesgos sociales preexistentes. Sin las salvaguardas adecuadas, estos sistemas pueden perpetuar o incluso amplificar discriminaciones basadas en raza, género, edad u otras características protegidas.

Casos documentados de algoritmos de contratación que discriminan a mujeres, sistemas de reconocimiento facial con tasas de error significativamente más altas para personas de piel oscura, o algoritmos de evaluación de riesgo criminal que perjudican sistemáticamente a ciertas minorías, ilustran la gravedad de este problema y la necesidad de enfrentarlo proactivamente.

El Dilema del Tranvía Robótico

El famoso "problema del tranvía" adquiere nuevas dimensiones cuando se aplica a vehículos autónomos. Si un coche sin conductor se enfrenta a una situación inevitable de daño, ¿cómo debería decidir entre diferentes cursos de acción? ¿Debería priorizar la seguridad de sus pasajeros sobre la de los peatones? ¿Discriminar entre diferentes tipos de personas basándose en edad, número o algún otro factor?

Estas decisiones, que los humanos tomamos instintivamente en fracciones de segundo, deben ser programadas explícitamente o aprendidas por sistemas autónomos, convirtiendo juicios morales implícitos en código explícito y cuantificable, con todas las complejidades éticas que esto conlleva.

Privacidad y Vigilancia

Los robots avanzados dependen de sensores sofisticados que recogen enormes cantidades de datos sobre su entorno, incluidas las personas que interactúan con ellos. Desde cámaras que utilizan reconocimiento facial hasta sensores que pueden monitorizar signos vitales o patrones de comportamiento, estos sistemas plantean serias preocupaciones sobre privacidad y consentimiento.

La normalización de robots en espacios públicos y privados podría conducir a una vigilancia ubicua y permanente, con profundas implicaciones para nuestras libertades civiles y expectativas de privacidad.

Marcos Regulatorios Emergentes

Ante estos desafíos, diversos actores están desarrollando marcos para regular el desarrollo y uso de robots autónomos:

Iniciativas Gubernamentales

La Unión Europea está a la vanguardia con su propuesta de Ley de Inteligencia Artificial, que adopta un enfoque basado en riesgos, clasificando las aplicaciones de IA (incluida la robótica autónoma) según su nivel de riesgo y aplicando requisitos proporcionales.

En Estados Unidos, agencias como la FDA están desarrollando marcos para regular dispositivos médicos basados en IA y robótica, mientras que la NHTSA trabaja en estándares para vehículos autónomos. Corea del Sur ha implementado lo que algunos han llamado la primera "ley de robots" del mundo, que establece normas éticas y de seguridad para el desarrollo robótico.

Autorregulación de la Industria

Reconociendo que la regulación gubernamental a menudo va por detrás de la innovación tecnológica, muchas empresas y asociaciones industriales están desarrollando códigos de conducta y mejores prácticas voluntarias.

Iniciativas como la Partnership on AI, que reúne a gigantes tecnológicos como Google, Microsoft y Amazon con organizaciones de la sociedad civil, buscan establecer principios para el desarrollo responsable de la IA y la robótica. Empresas individuales como Boston Dynamics han publicado compromisos públicos sobre usos éticos de sus tecnologías robóticas.

Estándares Internacionales

Organismos como ISO (Organización Internacional de Normalización) están desarrollando estándares específicos para robótica, como la serie ISO 13482 para robots de cuidado personal. IEEE tiene una iniciativa global sobre ética de sistemas autónomos e inteligentes que ha producido diversos estándares y recomendaciones.

Estos esfuerzos buscan establecer un lenguaje común y expectativas mínimas que puedan servir como base para regulaciones más específicas y promover la interoperabilidad y seguridad a nivel global.

Principios Éticos para la Robótica Autónoma

A través de diversas iniciativas, está emergiendo un consenso sobre principios éticos fundamentales que deberían guiar el desarrollo de robots autónomos:

Seguridad y No Maleficencia

Los robots autónomos deben ser diseñados y operados de manera que minimicen el riesgo de daño a humanos u otros seres sintientes. Esto implica no solo seguridad física, sino también protección contra daños psicológicos, económicos o sociales.

Iniciativas como los Principios de Asilomar para la IA y la Carta de Robótica de Corea destacan la seguridad como valor primordial, priorizándola incluso sobre la eficiencia o funcionalidad cuando existen compromisos inevitables.

Transparencia y Explicabilidad

Los sistemas robóticos autónomos, especialmente aquellos que toman decisiones significativas sobre personas, deberían ser transparentes en su funcionamiento y capaces de explicar sus decisiones en términos comprensibles para los usuarios afectados.

Este principio enfrenta desafíos técnicos significativos, especialmente con sistemas de aprendizaje profundo cuyo funcionamiento interno puede ser intrínsecamente opaco, pero se considera cada vez más esencial para la rendición de cuentas y la confianza pública.

Autonomía y Dignidad Humana

Los robots autónomos deben respetar y potenciar la autonomía humana, no socavarla. Esto implica diseñar sistemas que complementen las capacidades humanas y amplíen nuestras opciones, en lugar de restringirlas o manipularnos.

El concepto de "humano en el bucle" (human-in-the-loop) es central para muchos marcos éticos, enfatizando que los humanos deben mantener la capacidad de supervisión y veto sobre decisiones automatizadas en contextos críticos.

Justicia y No Discriminación

Los beneficios y riesgos de los sistemas robóticos autónomos deben distribuirse equitativamente, y estos sistemas no deben discriminar injustamente basándose en características como raza, género, edad o discapacidad.

Esto requiere atención cuidadosa a los datos de entrenamiento, pruebas rigurosas para detectar sesgos, y consideración de los impactos diferenciados que estas tecnologías pueden tener en diversos grupos sociales.

Privacidad y Protección de Datos

Los robots que interactúan con personas inevitablemente recopilan datos sobre ellas. Estos sistemas deben respetar la privacidad, obtener consentimiento informado cuando sea aplicable, y manejar datos personales con las salvaguardas adecuadas.

Regulaciones como el GDPR en Europa ya establecen requisitos estrictos para el procesamiento de datos personales, y estos deben adaptarse y aplicarse específicamente al contexto de sistemas robóticos con capacidades avanzadas de sensores y procesamiento.

Desafíos Prácticos de Implementación

Traducir estos principios éticos en prácticas concretas y regulaciones efectivas enfrenta numerosos desafíos:

Equilibrio entre Innovación y Regulación

Las regulaciones demasiado restrictivas o prematuras podrían sofocar la innovación y privar a la sociedad de beneficios potenciales. Por otro lado, un enfoque demasiado laxo podría permitir daños significativos antes de que se implementen salvaguardas adecuadas.

Encontrar este equilibrio requiere colaboración estrecha entre reguladores, industria, academia y sociedad civil, así como enfoques adaptativos que puedan evolucionar con la tecnología.

Divergencia Cultural y Geopolítica

Las normas éticas y las prioridades varían significativamente entre diferentes culturas y sistemas políticos. Lo que se considera un uso aceptable de robots autónomos en un país puede ser controvertido o incluso prohibido en otro.

Estas diferencias se reflejan en enfoques regulatorios divergentes, desde el más centrado en la privacidad de Europa hasta el enfoque más orientado al mercado de Estados Unidos o el modelo de mayor control estatal en China. Navegar estas diferencias mientras se busca cierta armonización internacional es un desafío significativo.

Ritmo Acelerado de Desarrollo Tecnológico

La robótica y la IA están avanzando a un ritmo que supera con creces los típicos ciclos regulatorios y legislativos. Para cuando se implementa una regulación, la tecnología que pretende gobernar puede haber evolucionado significativamente.

Esto requiere enfoques regulatorios más ágiles y adaptativos, posiblemente incorporando "areneros regulatorios" (regulatory sandboxes) donde nuevas tecnologías puedan ser probadas bajo supervisión controlada, o principios basados en resultados en lugar de prescripciones técnicas específicas.

Complejidad Técnica y Asimetría de Información

Los reguladores y el público general a menudo carecen del conocimiento técnico para evaluar adecuadamente los riesgos y beneficios de sistemas robóticos avanzados. Esta asimetría de información complica tanto la elaboración de regulaciones efectivas como el consentimiento informado de los usuarios.

Abordar este desafío requiere mayor transparencia por parte de los desarrolladores, inversión en capacitación técnica para reguladores y esfuerzos de divulgación para educar al público general sobre estas tecnologías.

El Camino Hacia Adelante

A pesar de estos desafíos, hay pasos concretos que podemos tomar para avanzar hacia un futuro donde los robots autónomos se desarrollen y desplieguen de manera ética y responsable:

Desarrollo de Herramientas Técnicas para la Ética

Necesitamos invertir en investigación sobre "ética por diseño" y herramientas técnicas que faciliten la implementación de principios éticos en sistemas robóticos. Esto incluye métodos para detectar y mitigar sesgos en algoritmos, técnicas para hacer sistemas de IA más explicables, y marcos formales para verificar que los sistemas cumplen con requisitos éticos especificados.

Iniciativas como el programa de Verificación y Validación de Sistemas Autónomos de la NASA o el proyecto Ethical AI de DeepMind están desarrollando metodologías prometedoras en esta dirección.

Educación y Formación Interdisciplinaria

Necesitamos integrar consideraciones éticas en la formación de ingenieros, programadores y otros profesionales involucrados en el desarrollo de sistemas robóticos. Simultáneamente, debemos proporcionar formación técnica a eticistas, reguladores y responsables políticos para que puedan participar efectivamente en estos debates.

Universidades de todo el mundo están respondiendo con nuevos programas interdisciplinarios que combinan ingeniería, ciencias de la computación, ética, derecho y ciencias sociales, preparando a la próxima generación para abordar estos desafíos complejos.

Participación Amplia de Stakeholders

Las decisiones sobre cómo regular y gobernar los robots autónomos no deberían dejarse solo en manos de expertos técnicos o grandes corporaciones. Necesitamos procesos inclusivos que involucren a diversos grupos afectados, incluyendo usuarios potenciales, trabajadores cuyas ocupaciones podrían verse impactadas, y representantes de poblaciones vulnerables.

Iniciativas como el Observatorio de Ética de la UNESCO y diversos paneles ciudadanos sobre tecnologías emergentes ofrecen modelos para esta participación ampliada.

Colaboración Internacional

Dado el carácter global de estas tecnologías y sus impactos, necesitamos mayor coordinación internacional, no solo entre gobiernos sino también involucrando a organizaciones internacionales, sociedad civil global y comunidad científica internacional.

Esfuerzos como el Grupo de Expertos en IA de la OCDE o la Iniciativa Global sobre Ética de la IEEE están comenzando a construir este diálogo internacional, pero aún queda mucho por hacer para desarrollar normas y estándares verdaderamente globales.

Conclusión: Construyendo un Futuro Robótico Centrado en el Humano

Los robots autónomos tienen el potencial de transformar nuestra sociedad de maneras profundamente positivas: aliviando trabajos peligrosos y repetitivos, aumentando la productividad, permitiendo nuevas soluciones médicas, y mejorando nuestra calidad de vida de innumerables formas. Pero este potencial solo se realizará plenamente si desarrollamos y desplegamos estas tecnologías de manera que respeten valores humanos fundamentales y eviten daños significativos.

La buena noticia es que aún estamos en las etapas iniciales de esta revolución tecnológica. Tenemos la oportunidad de dar forma al desarrollo de robots autónomos de manera que sirvan a nuestros valores y necesidades colectivas, en lugar de simplemente adaptarnos a las consecuencias de tecnologías desarrolladas sin consideración suficiente de sus implicaciones más amplias.

Esto requerirá un enfoque verdaderamente interdisciplinario que combine experiencia técnica con perspectivas éticas, legales y sociales. Requerirá colaboración entre sectores que tradicionalmente han operado en silos separados: industria, academia, gobierno y sociedad civil. Y, fundamentalmente, requerirá un compromiso compartido con la visión de que la tecnología debe servir y potenciar a la humanidad, no subordinarla.

El futuro de la robótica autónoma no está predeterminado. Es una historia que estamos escribiendo colectivamente a través de nuestras decisiones sobre investigación, desarrollo, regulación y adopción de estas tecnologías. Al enfrentar proactivamente los desafíos éticos y regulatorios que plantean, podemos ayudar a asegurar que esta historia tenga un desenlace que beneficie a toda la humanidad.